你是否曾面对一堆杂乱无章的 GPS 点位数据,感觉它们就像一团乱麻,毫无头绪?这些看似随机的经纬度坐标,实际上蕴藏着巨大的价值,无论是用于分析城市交通流量、优化物流配送路线,还是理解用户行为模式。然而,从原始数据到清晰直观的轨迹图,中间需要一套严谨且科学的数据处理流程。

直面这个挑战的关键,在于将海量的原始点位数据,通过系统化的方法,转化为具有洞察力的结构化信息。简单来说,轨迹数据处理的核心,就是为这些混乱的数据“正骨”,让它们开口讲述背后的故事。

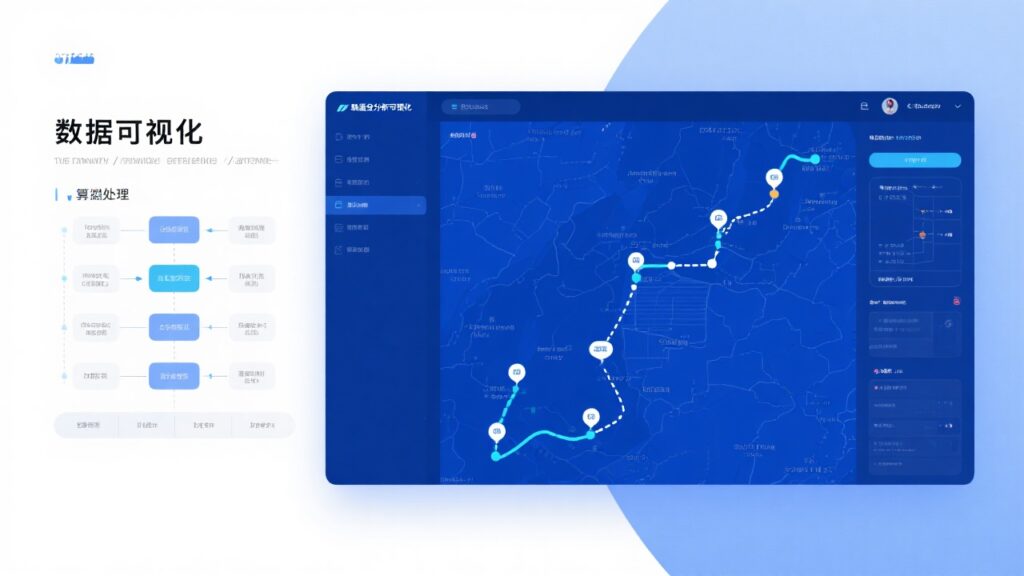

在我们深入每个技术细节之前,不妨先快速了解一下轨迹数据处理的四大核心阶段,这构成了我们从0到1的完整路径:

- 数据预处理: 这是整个流程的基石。它包括数据清洗、去噪和修复,旨在剔除无效信息,修正错误数据,为后续所有分析打下坚实的基础。

- 轨迹分割与构建: 将连续的、可能是跨越数天甚至数月的点位流,切分成一段段有意义的独立行程,比如一次完整的通勤或一次周末出游。

- 高级分析与挖掘: 在处理好的轨迹基础上,通过聚类、模式识别等方法提取深层洞察。例如,发现城市中的热门通勤走廊,或识别用户的核心活动区域。

- 轨迹可视化: 最终,我们需要将这些抽象的数据转化为直观的轨迹图、热力图等,让分析结果能够被清晰地理解和展示。

本文将带你完整走过这四个阶段,通过具体的方法和技巧,让你掌握将原始点位数据转化为商业洞察的系统能力。

阶段一:数据预处理 - 为混乱的原始数据“正骨”

任何高质量的数据分析,都始于高质量的数据源。对于轨迹数据而言,预处理阶段的重要性无论如何强调都不过分。跳过这一步直接分析,得出的结论很可能是失之毫厘,谬以千里。

数据清洗:剔除无效与异常数据

数据清洗的目标是处理掉那些明显错误或无用的数据点,确保数据的一致性和准确性。

- 处理缺失值: GPS信号在隧道、地下停车场或高楼林立的区域容易丢失,造成轨迹中断。处理这种断点,不能简单地删除,否则会丢失完整的行程信息。常用的方法是插值法,例如线性插值(在两个已知点之间画一条直线来估算中间点)或更复杂的动力学插值(考虑物体的速度和加速度来预测缺失点),后者在车辆轨迹修复中效果更佳。

- 去除重复值: 由于设备硬件或网络传输的抖动,有时会收到完全相同的时间戳和坐标点。这些冗余数据需要被清理,避免在计算速度或停留时间时产生误判。

- 过滤异常值(Outliers): 你可能见过地图上突然“瞬移”到几公里外的点,这就是典型的“漂移点”。这类异常值会严重干扰轨迹分析。过滤它们通常基于物理规则,例如设定一个速度或加速度的阈值,任何两个连续点计算出的速度超过了现实中可能的最大值(如300公里/小时),则可判定为异常点并予以剔除。

噪声过滤:让轨迹路线更平滑、更真实

经过清洗后,轨迹数据中仍可能存在由信号波动引起的轻微抖动,使得路线看起来曲曲折折,不符合真实的运动轨迹。噪声过滤的目的就是平滑这些抖动。

- 移动平均滤波(Moving Average Filter): 这是最简单高效的方法之一。它通过计算一个时间窗口内(如前后5个点)坐标的平均值,来更新当前点的位置。这种方法能快速实现初步的平滑,但可能会牺牲一些轨迹的细节。

- 卡尔曼滤波(Kalman Filter): 这是一种更高级的滤波算法。它不仅考虑过去的位置点,还会建立一个运动状态模型,预测下一个点可能出现的位置,并将预测值与实际观测值进行加权融合。因此,它在处理高速运动或需要高精度轨迹的场景(如航空、自动驾驶)中表现极为出色。

- 高斯滤波(Gaussian Filter): 类似于移动平均,但它是一种加权平均。它认为离当前点越近的点,其坐标值的参考价值越大,权重也越高。这种方法产生的平滑效果通常比简单的移动平均更自然。

坐标系转换与地图匹配(Map Matching)

这是预处理的最后一步,也是让轨迹数据产生质变的一步。

- 统一坐标系: 全球定位系统(GPS)获取的数据通常基于WGS-84坐标系。但在进行地图可视化或与其他地理数据叠加分析时,必须确保所有数据都在同一个坐标系下,避免因坐标系不匹配导致的位置偏差。

- 地图匹配的价值: 即使经过了去噪和平滑,GPS轨迹点依然可能漂浮在道路之外。地图匹配技术的核心价值,就是利用算法将这些漂移的GPS点“吸附”到最匹配的真实道路网络上。经过地图匹配后,你不仅能得到一条精确贴合道路的轨迹,还能获得丰富的道路信息,如道路等级、限速、车道方向等,这为后续的驾驶行为分析、路线合规性判断等应用提供了坚实基础。

阶段二:轨迹分割 - 从连续点流中识别“有效行程”

原始的GPS数据往往是连续不断的时间序列,可能记录了某用户一整天的所有位置。但对于分析而言,我们更关心的是其中一段段有特定目的的“行程”。

为什么要进行轨迹分割?

轨迹分割的目的,就是将这一整条连续的定位数据流,智能地切分成多个独立的行程片段。例如,将一个用户一天的数据切分为“从家到公司”、“午间外出就餐”、“从公司回家”这三个独立的轨迹。只有完成了分割,我们才能对每一次出行进行独立的分析,比如计算通勤时长、分析出行目的等。

常见的轨迹分割方法

分割的依据,本质上是对“停留”或“行程中断”的定义。

- 基于时间间隔: 这是最简单直观的方法。当两个连续定位点的时间差超过一个预设的阈值(例如30分钟或1小时),我们就认为前一段行程已经结束,新一段行程即将开始。这个阈值需要根据具体的业务场景来设定。

- 基于停留点检测(Stop-Point Detection): 这种方法更为精确。它通过算法识别用户在某个小区域内(如半径100米)停留超过一定时间(如15分钟)的位置。这些被识别出的“停留点”自然就成为了分割不同行程的断点。这种方法对于分析用户的活动中心(如家、公司)非常有效。

- 基于速度变化: 在车辆轨迹中,速度的变化是判断行程起止的重要标志。当车辆速度长时间接近于零,可以判断为一次停留。通过监测速度从高速状态锐减至零,并持续一段时间,可以准确地识别出行程的终点。

阶段三:高级分析与挖掘 - 提取轨迹背后的“商业价值”

当轨迹数据被清洗、分割并构建成一段段清晰的行程后,真正的价值挖掘才刚刚开始。

轨迹聚类:发现热门路线与行为模式

轨迹聚类是将大量相似的轨迹聚合在一起,从而发现群体性的行为模式。

- 识别通勤走廊: 将一个城市成千上万条上下班的通勤轨迹进行聚类,可以清晰地识别出主要的交通走廊和热点路段,为城市交通规划和公共交通线路优化提供数据支持。

- 发现用户群体偏好: 通过聚类分析,可以发现不同用户群体(如学生、白领)的典型活动轨迹。例如,分析外卖骑手的热门配送路线,或者识别出游客最喜欢的城市观光路径,这些信息在商业选址、精准营销和旅游产品设计中极具价值。

- 常用算法: 在轨迹聚类领域,DBSCAN(基于密度的聚类算法)因其能发现任意形状的簇且无需预先指定簇的数量而备受青睐。针对轨迹数据特性优化的TRACLUS等算法也应用广泛。

热点区域(Hotspot)与兴趣点(POI)分析

- 识别高频活动区域: 通过计算轨迹点在地理空间上的分布密度,我们可以生成一张热力图,直观地发现用户最常活动的区域。这些热点区域可能是他们的居住区、工作区,或是常去的商业中心。

- 关联兴趣点: 单纯知道热点区域还不够,更有价值的是知道这些区域里有什么。将识别出的热点区域与兴趣点(POI)数据(如商场、餐厅、公园、地铁站等)进行叠加分析,可以极大地丰富用户画像。例如,发现一个用户的热点区域集中在高端商圈和写字楼,那么他的消费能力和职业属性就有了初步的轮廓。

核心技巧对比:不同数据处理方法的优劣与选择

为了帮助你更好地根据实际需求选择合适的技术,这里我们对前文提到的一些核心处理方法进行一个简单的对比。

| 处理方法 |

优点 |

缺点 |

适用场景 |

| 移动平均滤波 |

实现简单,计算速度快 |

平滑效果有限,可能丢失轨迹细节 |

对实时性要求高、原始数据质量尚可的初步平滑处理场景。 |

| 卡尔曼滤波 |

精度高,能综合运动状态,有效处理非线性运动 |

实现相对复杂,计算量较大 |

航空、航海、自动驾驶等对轨迹精度和状态预测要求极高的领域。 |

| 停留点检测 |

逻辑直观,易于理解和实现,能有效识别活动中心 |

参数(时间、距离阈值)的选择对结果影响大,需要经验调优 |

分析用户停留行为,如商圈人流分析、物流中转站识别、个人生活规律分析。 |

| DBSCAN聚类 |

能发现任意形状的轨迹簇,无需预设簇的数量,对噪声不敏感 |

对密度变化敏感,处理高维或密度不均的轨迹数据时效果可能下降 |

热门路线发现、交通走廊识别、用户群体划分等群体行为模式挖掘。 |

阶段四:轨迹可视化 - 让数据“开口说话”

最后一步,也是最直观的一步,就是将分析结果通过图形化的方式呈现出来。好的可视化不仅是结果的展示,更是进一步发现问题的工具。

选择合适的可视化工具与库

根据你的角色和需求,可以选择不同的工具:

- 编程库(适合开发者): 如果你使用Python进行数据分析,Folium、Kepler.gl 以及 Matplotlib/GeoPandas 组合是非常强大的选择,它们可以让你在代码中灵活地创建各种交互式地图和静态轨迹图。

- 桌面软件(适合分析师): 专业的地理信息系统软件如 QGIS(开源免费)和 ArcGIS 提供了强大的空间数据处理和制图功能,无需编程即可完成复杂的轨迹可视化。

- 商业智能工具(BI): Tableau、Power BI 等主流BI工具也内置了强大的地图可视化功能,非常适合将轨迹分析结果整合到商业仪表盘中。

绘制轨迹图的关键技巧与表现形式

- 单条轨迹图: 这是最基础的可视化。为了增加信息量,可以用不同的颜色来区分不同的行程(如上班用蓝色,回家用绿色),并清晰地标记出起点、终点和运动方向箭头。

- 多轨迹叠加图: 将大量的轨迹直接叠加在地图上,轨迹重叠越多的地方颜色越深。这种图能非常直观地展示出路网的流量分布和交通的“动脉”。

- 热力图(Heatmap): 它不显示轨迹的路线,而是展示轨迹点的空间分布密度。颜色越亮(通常是红色或黄色)的区域,代表轨迹点越密集,也就是活动越频繁的热点区域。

- 时空立方体(Space-Time Cube): 这是一种更高级的三维可视化方法。它将二维的地理空间(X, Y轴)加上一维的时间轴(Z轴),从而在一个立方体中展示轨迹的时空变化过程,非常适合分析轨迹的动态演变模式。

常见问题解答 (FAQ)

Q1: 处理大规模轨迹数据时,有哪些性能优化的建议?

处理百万甚至上亿级别的轨迹数据时,单机处理往往力不从心。建议采用分布式计算框架(如Apache Spark)进行并行处理,它能将计算任务分解到多个计算节点上。此外,使用高效的空间索引(如R-tree或Quadtree)来组织数据,可以极大地加速空间查询(如查找某个区域内的所有轨迹点)的效率。

Q2: GPS数据处理中最常见的错误是什么,如何避免?

最常见也最致命的错误,就是忽略数据预处理阶段,直接将原始数据用于分析或建模。这会导致分析结果中充满了由噪声、漂移和数据缺失带来的“假象”。避免这个问题的唯一方法,就是严格执行数据清洗、噪声过滤,并在必要时进行地图匹配,确保用于分析的数据是干净、准确且贴合现实的。

Q3: 如何评估轨迹数据处理的质量?

一个有效的方法是通过与“地面真实情况”(Ground Truth)进行对比来评估。例如,如果你处理的是公交车的GPS数据,可以将处理后的轨迹与已知的公交线路图进行叠加比较,计算其重合度或偏离误差。对于个人轨迹,可以与个人自己记录的行车日志或手机健康应用中的运动记录进行比对,以验证处理结果的准确性。

Q4: 除了GPS,还有哪些来源的轨迹数据?

GPS只是来源之一。广义上的轨迹数据还包括:手机基站信令数据(精度较低,但覆盖面广)、Wi-Fi定位数据(室内定位常用)、共享单车或网约车的订单数据(包含了起终点和路线信息)、甚至是社交媒体的签到数据。不同来源的数据各有优劣,在实际应用中常常需要融合多种数据源来获得更全面的洞察。

总结:将数据点连接成具有洞察力的故事

回顾我们走过的这四个核心步骤——从预处理的“正骨”,到轨迹分割的“断句”,再到高级分析的“深挖”,最后是可视化的“表达”,每一步都是将原始数据点转化为商业智慧不可或缺的环节。

我们必须认识到,轨迹数据分析的最终目标,从来不是为了技术本身,而是为了驱动更科学的商业决策。无论是优化一条物流路线节省的成本,还是通过用户行为分析提升的营销转化率,这才是数据点最终连接成的、具有商业价值的故事。现在,你已经掌握了这套完整的方法论,是时候开启你的第一个轨迹数据分析项目了。